こんにちは。Osukeラーニング運営者の「おーすけ」です。

「Gemini APIって聞いたことあるけど、実際どうやって使うの?」「モデルがいっぱいあってどれを選べばいいかわからない…」そんな悩みを抱えている方、多いんじゃないでしょうか。私自身、最初にGemini APIを触り始めたとき、モデルの種類の多さや料金の複雑さに頭を抱えた経験があります。

この記事では、Google Gemini APIの基本的な使い方から、ProとFlashなど各モデルの違い、Pythonでの実装方法、料金体系、そして429エラーへの対処法まで、実務で使えるレベルで丁寧に解説します。無料枠でどこまでできるのか、コンテキストキャッシュを使ったコスト削減の方法、さらにはChatGPTやClaudeとの比較まで、ひとつの記事で全部わかるように書きました。

「とりあえず動かしてみたい」という初心者の方から、「本番環境での運用コストをなんとかしたい」という中級者の方まで、幅広く役に立てる内容を目指しています。ぜひ最後まで読んでみてください。

記事のポイント

- Gemini APIの各モデル(Pro・Flash・Flash-Lite)の特徴と使い分け方

- Pythonによる最新SDK(google-genai)を使った具体的な実装手順

- 無料枠の制限と有料プランの料金体系・コスト削減の方法

- 429エラーや安全設定など運用時のトラブル対処法

Gemini APIの使い方:モデル選定から基本実装まで

Gemini APIを使いこなすための第一歩は、「どのモデルを使うか」を正しく判断することです。ここでは、APIの概要から始まり、最新SDKを使った実装の基本、そしてモデルごとの違いについて詳しく見ていきましょう。

Gemini APIとは何か:Google AIの公式インターフェース

Gemini APIは、GoogleがGeminiモデルファミリーへのアクセスを開発者に提供するための公式インターフェースです。平たく言えば、「GoogleのAIを自分のアプリやプログラムから呼び出すための接続口」ですね。

Geminiシリーズは、Google DeepMindの知見を結集して開発されており、最初からマルチモーダル(テキスト・画像・音声・動画を統合的に扱える)として設計されている点が大きな特徴です。後からマルチモーダル機能を追加した他のモデルとは根本的な設計思想が違います。

2026年時点での主なラインナップは、Gemini 3.1シリーズ(最新世代)とGemini 2.5シリーズ(安定世代)、そして特定用途向けの特殊モデルで構成されています。GoogleはこのAPIをGoogle AI Studio(個人・中小向け)とGoogle Cloud Vertex AI(エンタープライズ向け)の二つのプラットフォームから提供しています。

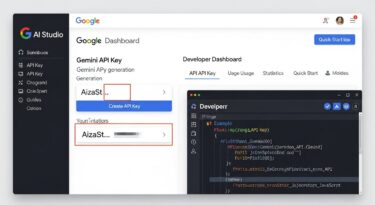

APIキーの取得はGoogle AI Studioにアクセスし、「Get API key」から無料で行えます。クレジットカードの登録なしで最新モデルを試せる点は、開発者にとって非常に助かるポイントですね。APIキーを取得したら、環境変数GEMINI_API_KEYに設定するのが最もセキュアな管理方法です。コードにAPIキーを直接書き込むのは絶対に避けましょう。GitHubなどに誤ってアップロードしてしまうリスクがあります。

補足:Google AI StudioとVertex AIの違い

Google AI Studioは個人開発者やスタートアップ向けで、シンプルなAPIキー認証で使えます。Vertex AIはGoogle Cloud上で動く企業向けプラットフォームで、より厳格なセキュリティやSLA(サービス品質保証)が求められる本番環境に向いています。嬉しいことに、最新SDK(google-genai)はどちらにも対応しており、client = genai.Client(vertexai=True)と書くだけで切り替えられます。

Gemini APIが他のAI APIと一線を画すのは、そのコンテキストウィンドウの広さです。コンテキストウィンドウとはAIが一度に処理できる「作業メモリ」のようなもので、Gemini 3.1 Proは最大200万トークンをサポートしています。日本語で言えばおよそ100万文字分、文庫本で数十冊分の情報を一度の会話に含められる計算です。これは競合モデルと比べても圧倒的な規模です。

また、Gemini APIは「グラウンディング(Grounding)」という機能も提供しており、Google検索の結果をリアルタイムで取り込みながら回答を生成できます。これにより、学習データのカットオフ以降の最新情報にも対応できるのが強みですね。

最新SDKの使い方:google-genaiパッケージの導入とPython実装

Gemini APIをPythonで実装する際、最も重要なことがあります。それは「使うべきSDKが変わった」という事実です。かつて広く使われていたgoogle-generativeaiパッケージは、2025年以降に非推奨(deprecated)となっています。現在の「ゴールデンルール」は、統合標準ライブラリgoogle-genaiを使うことです。

古いチュートリアルやQiitaの記事を参考にしていると、旧パッケージを使ったコードに出くわすことがあります。エラーや挙動の不一致に悩む前に、まず使っているSDKのバージョンを確認することをおすすめします。

ステップ1:パッケージのインストール

ターミナルで以下のコマンドを実行します。

pip install google-genaiステップ2:APIキーの設定

APIキーをコードに直書きせず、環境変数で管理します。

# Macの場合(~/.zshrcや~/.bashrcに追記)

export GEMINI_API_KEY="your_api_key_here"ステップ3:基本的なテキスト生成コード

from google import genai

# クライアントの初期化(環境変数からキーを自動取得)

client = genai.Client()

# Gemini 3.1 Flashモデルを使ってテキスト生成

response = client.models.generate_content(

model="gemini-3.1-flash-preview",

contents="Gemini APIの特徴を3つ教えてください。"

)

print(response.text)これだけでGemini APIを呼び出せます。驚くほどシンプルですよね。client = genai.Client()だけでクライアントが初期化され、環境変数からAPIキーが自動的に読み込まれます。

ポイント:モデル名の指定方法

modelパラメータには、使用したいモデルの識別子を指定します。例えば"gemini-3.1-flash-preview"や"gemini-2.5-pro"といった形式です。Google AI Studioのモデル一覧ページで最新のモデル名を確認するのがおすすめです。特定のモデル名に依存しすぎず、抽象化されたコード設計を意識することが、モデルの世代交代が激しいGeminiを長期で使い続けるコツです。

GenerateContentConfigオブジェクトを使えば、出力の詳細をコントロールできます。最もよく使うパラメータはtemperature(出力の多様性)とmax_output_tokens(最大出力トークン数)です。

from google import genai

from google.genai import types

client = genai.Client()

config = types.GenerateContentConfig(

temperature=0.3, # 0に近いほど事実重視、1に近いほど創造的

max_output_tokens=2048, # 最大出力トークン数

system_instruction="あなたは親切なアシスタントです。日本語で回答してください。"

)

response = client.models.generate_content(

model="gemini-3.1-flash-preview",

contents="機械学習とは何ですか?",

config=config

)

print(response.text)system_instruction(システム命令)は特に重要です。AIに「あなたはプロの編集者です」「日本語でのみ回答してください」といった役割や制約を与えられるため、出力のトーンや形式を安定させることができます。チャットボットや特定用途のアプリを作る際は必ず設定するようにしましょう。

マルチターン(複数回のやり取り)の会話を実装する場合は、client.chats.create()を使います。これにより会話履歴が自動的に管理され、文脈を保ちながら対話できます。ChatGPTのAPIと同様の感覚で扱えますよ。

Geminiモデル一覧と選び方:ProとFlashの違いを徹底比較

Gemini APIを使う上で最も重要な判断の一つが「どのモデルを選ぶか」です。モデルを間違えると、コストが数十倍になったり、速度が遅すぎてユーザー体験を損なったりします。ここでは各モデルの特徴を丁寧に整理します。

| モデル名 | 世代 | 特徴・主な用途 | コンテキスト | 向いているタスク |

|---|---|---|---|---|

| Gemini 3.1 Pro | 最新(第3世代) | 最高の推論能力。ARC-AGI-2で77.1%達成 | 最大200万トークン | 複雑な分析、戦略立案、難解なコーディング |

| Gemini 3.1 Flash | 最新(第3世代) | 速度と品質のバランス型 | 最大100万トークン | チャットボット、要約、リアルタイム処理 |

| Gemini 3.1 Flash-Lite | 最新(第3世代) | 圧倒的な低コスト | 最大100万トークン | 大量バッチ処理、感情分析、定型タスク |

| Gemini 2.5 Pro | 第2.5世代 | 安定した推論能力。企業実績豊富 | 最大100万トークン | 技術文書解析、安定運用が必要なシステム |

| Gemini 2.5 Flash | 第2.5世代 | 高速レスポンス | 最大100万トークン | メール作成支援、アイデア出し |

| Gemini 2.5 Flash-Lite | 第2.5世代 | 旧世代最安モデル | 最大100万トークン | コスト最優先の大量処理 |

ProとFlashの根本的な違いは、「知識蒸留(Knowledge Distillation)」という技術にあります。Proモデルが持つ知識や推論パターンをFlashモデルに学習させることで、FlashはProの約1/10の料金で約4.8倍の処理速度(約163.6トークン/秒)を実現しています。高品質な「先生」の知識を、速くて安い「生徒」に受け継がせるイメージです。

モデル選択の実践的ガイドライン

- プロトタイプ・開発段階:まずFlashで試す。コストを抑えながら動作確認できる

- 本番環境でのチャットボット:Flashで十分なことが多い。速度とコストのバランスが良い

- 複雑な論文解析・法務文書処理:Proを使う。推論の精度が求められる

- 大量バッチ処理(1日1万件以上):Flash-Liteが最適。コストを最小化できる

- 長大なドキュメント全体の解析:Proの200万トークンコンテキストを活かす

「Gemini 3.1」の「.1」というバージョンアップは単なる機能追加ではなく、知能のコア部分への集中的なアップグレードを意味します。特に「Deep Think」という高度な思考プロセスが蒸留されており、日常的なプログラミングやデータ分析でも前世代を超える安定性を見せています。

実際の開発では、「動的モデルスイッチング戦略」をとることをおすすめします。通常のリクエストはFlashで処理し、複雑なケース(エラー修正や深い推論が必要な場面)だけProに切り替えるという方法です。コストを大幅に抑えながら、品質も維持できます。

マルチモーダルAPIの実装:画像・動画・音声の読み込ませ方

Gemini APIの最大の強みの一つが、テキスト以外のデータをシームレスに処理できる「ネイティブ・マルチモーダル」能力です。画像の内容を説明させたり、動画を解析してチャプターを自動生成したり、音声ファイルを文字起こしして要約したりといったことが、同じAPIで実現できます。

マルチモーダルデータをAPIに渡す方法は、データのサイズと用途によって3種類あります。

| 入力方法 | 最大サイズ | おすすめのケース |

|---|---|---|

| Inline Data(インライン) | 100MB未満 | 小さな画像、1分以内の音声。使い捨てリクエスト |

| Files API | 20GB(有料)/ 2GB(無料) | 100MB以上の大容量ファイル、長尺動画。複数リクエストで再利用 |

| Cloud Storage (GCS) | 実質無制限 | 企業レベルのバッチ処理、大量の動画アーカイブ解析 |

小さな画像を分析させる基本的なコードは以下のようになります。

import PIL.Image

from google import genai

client = genai.Client()

# 画像の読み込み

image = PIL.Image.open("sample.jpg")

response = client.models.generate_content(

model="gemini-3.1-flash-preview",

contents=["この画像に写っているものを詳しく説明してください。", image]

)

print(response.text)大容量の動画ファイルを扱う場合はFiles APIを使います。

from google import genai

client = genai.Client()

# 動画ファイルをアップロード

myfile = client.files.upload(path="meeting_recording.mp4")

response = client.models.generate_content(

model="gemini-3.1-pro-preview",

contents=[

myfile,

"この動画の内容を要約し、重要なポイントを箇条書きにしてください。"

"また、3分20秒付近で何が議論されているか教えてください。"

]

)

print(response.text)特筆すべきはGeminiの動画理解能力です。動画内の特定のタイムスタンプを参照して「3分20秒地点で起きている出来事を説明せよ」といった高度な時間軸クエリに応答できます。動画コンテンツのSEOタグ生成、チャプター分け、会議録の自動要約といったタスクでGeminiは業界標準になりつつあります。

音声ファイルの文字起こしも同様の方法で実装できます。医療・法務・メディアといった分野で、会議録や講義録の自動テキスト化に活用されています。

マルチモーダル機能を使うときの注意点として、Files APIでアップロードしたファイルはデフォルトで48時間後に削除されます。同じファイルを繰り返し使う処理(RAGシステムなど)を構築する場合は、毎回アップロードするか、ファイルIDを保存しておく仕組みを作る必要があります。

AIスキルをしっかり身につけたい方には、DMM 生成AI CAMP 学び放題![]() (PR)がおすすめです。無料セミナーから気軽に始められ、生成AIの実践的な使い方を学べます。

(PR)がおすすめです。無料セミナーから気軽に始められ、生成AIの実践的な使い方を学べます。

Gemini API model活用の料金・運用・競合比較

APIを実際のサービスで使う段階になると、気になるのが料金体系と安定した運用の方法です。このセクションでは、コストを賢く抑えるための具体的な戦略と、運用時に直面しやすい問題への対処法、そして他のAIとの比較について詳しく解説します。

無料枠と料金プランの全貌:従量課金の仕組みと注意点

Gemini APIの料金体系は、「無料枠(Free Tier)」と「有料階層(Pay-as-you-go)」の二段階で提供されています。個人開発者がとにかく試してみたい場合は無料枠で十分ですが、本番環境での運用には有料階層が必要です。

| モデル名 | 入力価格(20万トークン以下) | 入力価格(20万トークン超) | 出力価格(20万トークン以下) |

|---|---|---|---|

| Gemini 3.1 Pro | $2.00 / 1Mトークン | $4.00 / 1Mトークン | $12.00 / 1Mトークン |

| Gemini 3.1 Flash | $0.50 / 1Mトークン | – | $3.00 / 1Mトークン |

| Gemini 2.5 Pro | $1.25 / 1Mトークン | $2.50 / 1Mトークン | $5.00 / 1Mトークン |

| Gemini 1.5 Flash | $0.075 / 1Mトークン | $0.15 / 1Mトークン | $0.30 / 1Mトークン |

料金を理解する上で大切なのが「トークン」の概念です。日本語の場合、おおよそ「1文字=1〜2トークン」に相当します。100万トークンは文庫本数冊分に匹敵する膨大な情報量です。

注意:「ロング・コンテキスト価格」の罠

Gemini APIには、入力トークン数が一定数(通常20万トークン)を超えると単価が変動する「ロング・コンテキスト価格」が適用されます。例えばGemini 3.1 Proの場合、20万トークンを超えると入力価格が倍($2.00→$4.00)になります。長大なドキュメントを頻繁に処理するシステムでは、コストが予想外に膨らむ可能性があります。コンテキストキャッシュの活用を検討してください。

無料枠の制限についても把握しておく必要があります。クレジットカード登録なしで最新モデルを試せる点は素晴らしいのですが、2025年12月以降の「クォータ・カット」以降、無料枠の制限は厳しくなっています。Gemini 3.1 Proの場合、1日あたり約100回、1分あたり最大5回のリクエスト制限があることがあります。個人のお試しには十分ですが、本番環境での運用は現実的ではないですね。

また、無料枠では入力したコンテンツがGoogleのプロダクト改善やモデル学習に使用される可能性があります。個人的な趣味の開発なら問題ありませんが、顧客データや機密情報を扱う場合は必ず有料階層にアップグレードしましょう。

コンテキストキャッシュでコストを削減する方法

Gemini APIを使う上で、コスト削減の観点から最も注目すべき機能が「コンテキストキャッシュ(Context Caching)」です。特に、同じ大規模なデータセットを何度も参照するようなシステムを構築する場合、この機能の有無でコストが劇的に変わります。

コンテキストキャッシュとは、「よく使うデータを事前にGeminiのサーバー側に保存しておく」機能です。例えば、「自社の全製品マニュアル(200ページ分)を元に、ユーザーの質問に答えるチャットボット」を作るとします。キャッシュなしの場合、毎回のリクエストに200ページ分のデータを含めて送信しなければなりません。一方、キャッシュありの場合は初回だけデータを保存し、その後のリクエストでは「キャッシュID」を参照するだけで済みます。

| コスト種別 | Gemini 3.1 Flash | Gemini 3.1 Pro |

|---|---|---|

| キャッシュへの初回保存 | $0.01875 / 1Mトークン | $0.3125 / 1Mトークン |

| 保存維持(1時間あたり) | $1.00 / 1Mトークン | $4.50 / 1Mトークン |

| キャッシュからの読み込み | 通常入力料金の25% | 通常入力料金の25% |

キャッシュからの読み込みは通常の入力料金の約25%で済みます。同一のベースドキュメントに対して1時間に100回質問を投げるようなRAG(検索拡張生成)システムでは、キャッシュの活用は必須の戦略です。

from google import genai

from google.genai import types

import datetime

client = genai.Client()

# 大きなドキュメントをキャッシュに保存

document_content = open("large_manual.txt").read()

cache = client.caches.create(

model="gemini-3.1-flash-preview",

contents=[document_content],

config=types.CreateCachedContentConfig(

system_instruction="あなたは製品マニュアルの専門家です。",

ttl=datetime.timedelta(hours=1), # 1時間キャッシュを維持

)

)

# キャッシュを使ってリクエスト

response = client.models.generate_content(

model="gemini-3.1-flash-preview",

contents="製品の保証期間はどれくらいですか?",

config=types.GenerateContentConfig(

cached_content=cache.name,

)

)

print(response.text)コンテキストキャッシュを効果的に使うには、TTL(キャッシュの有効期限)の設定が重要です。短すぎると頻繁に再作成コストが発生し、長すぎるとストレージコストが嵩みます。実際の利用パターンに合わせて最適な時間を設定しましょう。

429エラーとレート制限への対処:指数バックオフの実装

Gemini APIを実際のサービスで運用し始めると、必ずと言っていいほど遭遇するのが「429 Too Many Requests」エラーです。これはレート制限(一定時間内のリクエスト数の上限)を超えたときに返されるエラーで、適切に対処しないとサービス全体が止まってしまう可能性があります。

Googleのプロジェクトは利用実績に応じて「ティア(Tier)」に分類され、それぞれのティアでリクエスト上限が異なります。

| ティア | 昇格条件 | Pro制限(RPM) | Flash制限(RPM) |

|---|---|---|---|

| Free(無料) | プロジェクト作成のみ | 5〜10 | 15〜20 |

| Tier 1 | 支払いアカウントの紐付け | 150 | 300 |

| Tier 2 | $100以上の支払い+3日経過 | 1,000 | 1,000 |

| Tier 3 | $1,000以上の支払い+30日経過 | 4,000+ | 4,000+ |

429エラーへの対処として最も重要な実装テクニックが「指数バックオフ(Exponential Backoff)」です。エラーを検知した際、再試行の間隔を2秒、4秒、8秒、16秒…と段階的に広げながらリトライする方法です。

import time

import random

from google import genai

from google.api_core import exceptions

client = genai.Client()

def generate_with_retry(prompt, max_retries=5):

"""指数バックオフを使ったリトライ付きリクエスト"""

for attempt in range(max_retries):

try:

response = client.models.generate_content(

model="gemini-3.1-flash-preview",

contents=prompt

)

return response.text

except exceptions.ResourceExhausted as e:

# 429エラーの場合

if attempt < max_retries - 1:

wait_time = (2 ** attempt) + random.uniform(0, 1)

print(f"レート制限に達しました。{wait_time:.1f}秒後にリトライします...")

time.sleep(wait_time)

else:

raise e

result = generate_with_retry("日本のAI市場の現状を教えてください。")さらに大規模なシステムでは、以下の追加策も有効です。

レート制限対策のまとめ

- グローバルエンドポイントの利用:単一リージョンに負荷を集中させず、Googleのグローバルネットワークで最適な負荷分散を行う

- プロビジョニング済みスループット:大規模エンタープライズ利用では事前にキャパシティを予約し、混雑時でも確実にレスポンスを得る仕組みを導入する

- リクエストキューの実装:急激なトラフィックの増加に備え、リクエストをキューに積んで順番に処理する設計にする

- Tier 2以上への早期移行:プロトタイプから商用サービスへの移行期に即座にTier 1以上にアップグレードしてRPMを確保する

安全設定のカスタマイズ:HarmCategoryと閾値の調整方法

Gemini APIには、有害なコンテンツの生成を防ぐための「安全設定(Safety Settings)」が組み込まれています。デフォルトでは適切なフィルタリングが行われていますが、用途によっては「過剰な拒絶」が問題になることがあります。例えば、医療系の解説記事を書かせようとしたら「危険なコンテンツ」として拒否された、といったケースです。

そのため、開発者はカテゴリーごとにブロックの閾値を調整できます。

| カテゴリー | 内容 | 設定可能な閾値 |

|---|---|---|

| HARM_CATEGORY_HATE_SPEECH | ヘイトスピーチ | BLOCK_NONE / BLOCK_LOW_AND_ABOVE / BLOCK_MEDIUM_AND_ABOVE / BLOCK_HIGH_AND_ABOVE |

| HARM_CATEGORY_HARASSMENT | 嫌がらせ | 同上 |

| HARM_CATEGORY_SEXUALLY_EXPLICIT | 性的表現 | 同上 |

| HARM_CATEGORY_DANGEROUS_CONTENT | 危険なコンテンツ | 同上 |

from google import genai

from google.genai import types

client = genai.Client()

# 安全設定をカスタマイズ

safety_settings = [

types.SafetySetting(

category="HARM_CATEGORY_DANGEROUS_CONTENT",

threshold="BLOCK_HIGH_AND_ABOVE" # 明らかに危険なものだけブロック

)

]

response = client.models.generate_content(

model="gemini-3.1-flash-preview",

contents="薬の副作用について詳しく教えてください。",

config=types.GenerateContentConfig(

safety_settings=safety_settings

)

)

# 生成がブロックされたか確認

if response.candidates[0].finish_reason == "SAFETY":

print("安全フィルターによりブロックされました。")

else:

print(response.text)生成がブロックされた場合、candidate.finish_reasonがSAFETYとして返され、テキストは空になります。この戻り値を必ずトラップして、ユーザーに適切な案内を表示する設計にしましょう。エラーをそのままユーザーに見せてしまうのはUX的に良くないですし、デバッグも難しくなります。

ChatGPT・Claudeとの比較:Gemini APIが選ばれる理由

Gemini APIを評価する上で、競合するOpenAIのGPT-5.4やAnthropicのClaude Opus 4.6/Sonnet 4.6との比較は避けて通れません。ただ、「どれが最強か」という単純な議論よりも、「何をやりたいかによって最適解が違う」という視点で見ることが重要です。

| 評価項目 | Gemini 3.1 Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|

| 高度な推論(GPQA) | 82.1%(3位) | 83.9%(2位) | 87.4%(1位) |

| コーディング(HumanEval) | 89.2%(3位) | 93.1%(1位) | 90.4%(2位) |

| 自然な文章生成 | 普通 | 良好 | 最高 |

| 最大コンテキスト | 200万トークン | 12.8万トークン | 20万トークン |

| 経済性(10Mトークン/月) | $62.50(最安) | $200.00(中) | $900.00(最高) |

ベンチマークスコアだけ見ると、Gemini 3.1 Proは推論とコーディングで3位ですが、実際の運用でGeminiが選ばれる明確な理由が3つあります。

1. 圧倒的なコンテキストウィンドウ

200万トークンというコンテキスト窓は、GPT-5.4の約15倍、Claude Opus 4.6の約10倍の規模です。1冊の本、プロジェクト全体のソースコード、数時間の会議録を「まるごと」AIの脳内に展開できます。RAGのように情報を細切れにして検索する手間が省け、情報の整合性を極めて高く維持できます。

2. コスト効率の高さ

同等のタスクをこなすためのコストを比較すると、Geminiは競合比で最安クラスです。SEOを意識した1万語以上のロングフォーム記事を生成する場合、Claudeは品質こそ高いですがGeminiと比べてコストが大幅に高くなります。Gemini 3.1 Flash-Liteを活用すれば、大量のコンテンツ生成を他のモデルの数分の一のコストで実現できます。

3. ネイティブ・マルチモーダルな動画処理

動画を直接理解し、シーンの切り替わりや特定の物体の出現を認識する能力において、Geminiは競合を一歩リードしています。動画コンテンツのSEOタグ自動生成、チャプター分け、要約といったタスクでは、Geminiが実質的な業界標準です。

補足:使い分けの実践的な考え方

私の経験から言うと、文章の自然さや深い推論が求められる用途(文学的な執筆、倫理的な判断が必要な分析)ではClaudeが頭一つ抜けています。純粋なコーディング能力ならGPT-5.4。しかしコスト対効果と大規模ドキュメント処理では、Geminiは圧倒的に強いです。予算を最小化しながら高い品質を実現したいなら、Gemini一択かなと思います。

Gemini APIのmodelを使いこなすためのまとめ:選択から運用まで

ここまでGemini APIの使い方から各モデルの特徴、料金体系、運用のコツ、競合比較まで幅広く解説してきました。最後に、実際に使い始めるための要点をまとめます。

モデル選択のまとめとしては、まずFlash(または Flash-Lite)で試し、品質に問題があればProに切り替えるアプローチが最もコスト効率に優れています。大量バッチ処理にはFlash-Lite、長大なドキュメント全体の解析が必要な場合はProの200万トークンコンテキストを活かしましょう。

実装面での重要ポイントは、旧SDK(google-generativeai)ではなく新SDK(google-genai)を使うこと、APIキーは必ず環境変数で管理すること、そして本番環境では指数バックオフを使ったエラー処理を実装することです。

コスト最適化の観点では、20万トークンを超えるリクエストには「ロング・コンテキスト価格」が適用されることを忘れずに。同一のベースデータを繰り返し使う場合はコンテキストキャッシュを積極的に活用しましょう。また、ビジネス用途では無料枠のデータ利用規約に注意が必要です。

Gemini APIは2026年現在、最も経済的で最も「広い」作業メモリを持つAIプラットフォームとして確立されています。モデルの世代交代が激しい分野ですが、特定のモデル名に依存しすぎない抽象化されたコード設計を心がけることで、長期的に安定した開発が可能です。

ぜひ今日からGoogle AI StudioでAPIキーを取得して、まずはシンプルなテキスト生成から試してみてください。最初の一歩を踏み出せば、あとはどんどん使いこなせるようになっていきます。このサイトでは引き続きGemini APIの活用事例や最新情報をお届けしていきますので、ブックマークしておいてもらえると嬉しいです。

🤖 AIスキルを、今すぐ体系的に学ぼう

「DMM 生成AI CAMP 学び放題」は、ChatGPT・Claude・画像生成AIなど最新の生成AIを実践的に学べるオンラインスクール。まずは無料セミナーで雰囲気を確かめてみてください。

※PR(成果報酬型広告)